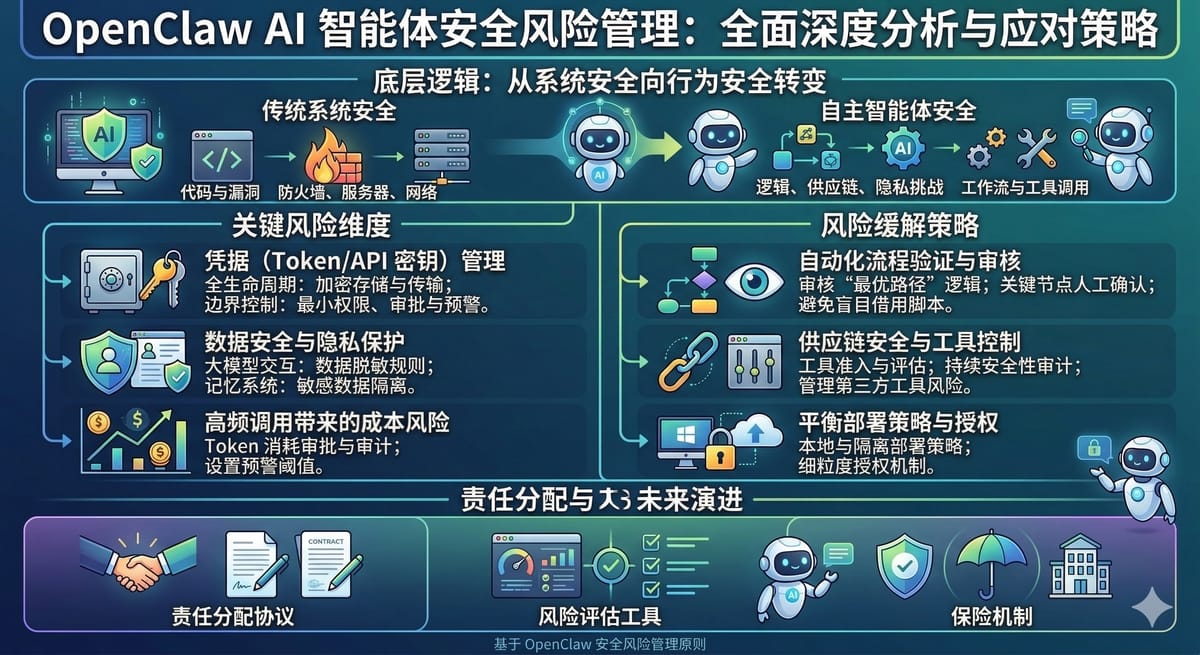

深度解析 OpenClaw 智能体:安全风险管理的底层逻辑与应对之道

随着以 OpenClaw 为代表的自主智能体(AI Agent)快速迭代,其强大的自动化能力在提升效率的同时,也引入了与传统信息化系统截然不同的安全风险。我们不能简单地将智能体安全等同于传统的网络安全,而应从更深层次的“业务与作业安全”逻辑出发,构建全方位的防护体系。

一、 范式转移:从“系统安全”到“行为安全”

传统安全关注点在于开发控制、部署环境、运营操作及攻防漏洞。然而,OpenClaw 作为一种具备自主规划和工具调用能力的智能体,其风险核心已从代码层面的缺陷,演变为逻辑、供应链及个人隐私的综合性挑战。

1. 自动化流程规划的“主观偏离”风险

OpenClaw 会根据目标自动设计工作流。

- 风险点: 自动化设计的“最优路径”往往基于算力逻辑,而非使用者的习惯或特定业务逻辑。这种“逻辑不一致”可能导致非预期的行为操作。

- 对策: 建立流程审核与验证机制,避免盲目借用第三方 Script,在关键节点引入人工确认。

2. 泛供应链安全:工具链的风险传导

OpenClaw 的核心能力来源于调用第三方工具(本地软件或云端 API)。

- 风险点: 风险往往不在 OpenClaw 本身,而在其调用的开源插件或第三方工具中。一旦工具链存在后门或漏洞,智能体将成为攻击者侵入系统的“跳板”。

- 对策: 建立工具准入与评估体系,明确哪些工具可被调用,并对其安全性进行持续审计。

二、 核心风险维度的深度管控

基于智能体特有的运行机制,我们需要在以下三个维度建立精细化控制:

1. 凭据(Token/API Key)的全生命周期管理

智能体需要存储大量第三方服务的 Token 才能正常工作。

- 存储与传输: 必须解决 Token 的加密存储问题,防止被非法读取。

- 复用与边界: 严格限制 Token 的复用范围。同一个 Token 用于不同任务时,其权限边界在哪里?需要设计一套基于最小权限原则的审批与预警机制。

2. 数据安全与个人隐私保护

在处理邮件、银行、购物等个人事务时,OpenClaw 会接触到极度敏感的隐私。

- 隐私外泄风险: 在与大模型(LLM)交互时,哪些信息应传给云端,哪些应本地脱敏?

- 记忆系统安全: 智能体的记忆系统(向量数据库等)如何存储用户隐私,是防范的重点。

- 对策: 建立敏感数据识别与脱敏规则判断机制。

3. “高频调用”带来的成本风险

智能体的信息处理速度远超人类。

- 风险点: 相比于人手工操作,智能体可能在短时间内调用成百上千次 API,导致 Token 消耗激增或账户资金爆掉。

- 对策: 设置用量预警阈值、用量审计及审批机制,平衡效率与成本。

三、 部署策略:平衡“全能”与“隔离”

关于 OpenClaw 部署在“个人主电脑”还是“独立设备(如 Mac Mini/云主机)”的争议,本质是权限与功能的博弈。

- 本地部署: 能处理个人文件、软件,体验最完整,但一旦发生误操作(如误删邮件、误格式化),损失巨大。

- 隔离部署: 虽安全受控,但脱离了个人数据环境,智能体将沦为简单的“在线工具处理员”,违背了个人助手的初衷。

- 建议: 厂商与用户应通过完善的授权机制(而非物理隔离)来解决。通过权限收紧与优化,在保证安全的前提下实现个人事务的处理。

四、 责任判定与未来演进

智能体安全的最终落地,需要多方协作:

- 责任分配协议: 供应方与使用者应在初期明确责任边界。

- 风险评估工具: 厂商应提供风险清单和评估工具,帮助用户识别当前配置下的潜在威胁。

- 引入保险机制: 网络安全行业应针对智能体自主行为可能带来的经济损失,设计相应的保险产品,为技术探索提供兜底。

总结

对于 OpenClaw 等智能体,安全管理不应是发展的阻碍,而应是其进化的阶梯。通过**“流程审计+权限受控+供应链管理”**的组合拳,我们才能在享受 AI 自动化红利的同时,守住安全的底线。